Barcelona, 07/05/2020 (El Pueblo en Línea) -Twitter sigue trabajando con funciones que permitan rebajar el nivel de hostilidad de algunos de los tuits que se publican en la red social. La plataforma está probando una nueva herramienta de moderación con la que se quiere advertir a los usuarios que estén a punto de publicar una respuesta que utilice lenguaje identificado como “ofensivo o dañino”, según La Vanguardia.

De momento se trata de un experimento limitado, que se está realizando tan solo entre algunos usuarios de iOS.

Según esta nueva función, el usuario que esté a punto de publicar una respuesta que incluya este lenguaje dañino, recibirá un aviso con el que la red le dará la opción de revisar su respuesta antes de que se publique. Twitter lo ha explicado mediante una publicación en su canal oficial.

Esta no es la primera vez que se prueba una herramienta parecida. Otras plataformas sociales ya cuentan con fórmulas para advertir de los mensajes conflictivos. Por ejemplo, Instagram cuenta con una función que advierte a los usuarios antes de publicar según contenidos, con un mensaje que alerta de que ese texto “se parece a otros que han sido reportados”.

Sillitas para esperar el autobús,

la última invención en una economía compartida

Sillitas para esperar el autobús,

la última invención en una economía compartida Se filtra por error el sexto episodio

de «Juego de Tronos»

Se filtra por error el sexto episodio

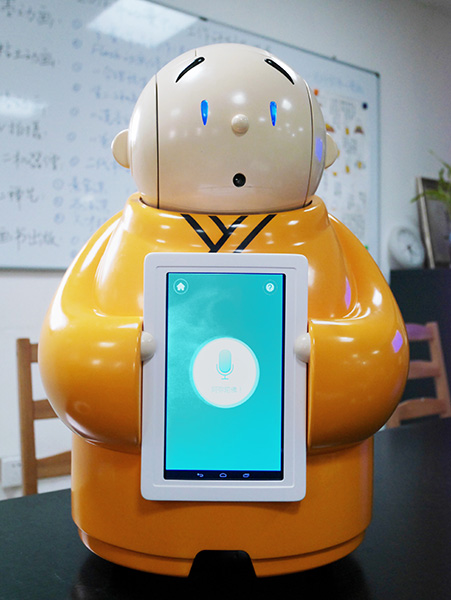

de «Juego de Tronos» Un robot monje aprende a hablar inglés

Un robot monje aprende a hablar inglés Se estrena el documental

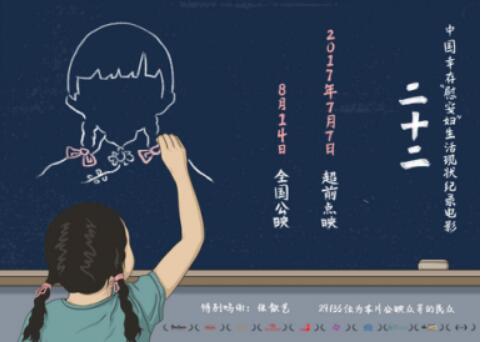

sobre “mujeres de consuelo” de China

Se estrena el documental

sobre “mujeres de consuelo” de China 57 universidades chinas

entre las 500 mejores del mundo

57 universidades chinas

entre las 500 mejores del mundo Las 10 cadenas hoteleras

más grandes del mundo

Las 10 cadenas hoteleras

más grandes del mundo ¿Cuánto paga un residente extranjero

por un alquiler en Beijing?

¿Cuánto paga un residente extranjero

por un alquiler en Beijing? Un graduado de Tsinghua convierte

la cría del esturión cuchara en una mina de oro

Un graduado de Tsinghua convierte

la cría del esturión cuchara en una mina de oro La dedicación de una niña

al arte de la Ópera de Pekín

La dedicación de una niña

al arte de la Ópera de Pekín