Madrid, 20/03/2019(El Pueblo en Línea) - El tiroteo de Nueva Zelanda ha vuelto a poner en cuestión a las redes sociales y su capacidad para reducir la viralidad de unos hechos que pueden herir sensibilidades. Facebook ha asegurado que la retransmisión en directo de Brenton Tarrant, autor de la masacre en la mezquita de Christchurch que dejó unas 50 personas muertas, se pudo ver unas 200 veces aunque alcanzó las 4.000 reproducciones antes de ser eliminado por la compañía, según ABC.

La multinacional estadounidense ha desvelado el resultado de una auditoría interna para esclarecer de qué manera se pudieron saltar los controles de revisión durante unos 17 minutos antes de bloquear la emisión en «streaming» y eliminar las cuentas del sospechoso. El primer informe sobre el video original se realizó 29 minutos después del comienzo de la transmisión y 12 minutos después de que terminó. Nadie lo denunció hasta media hora después, ningún usuario, reabriendo así el debate acerca de la responsansabilidad de la propia comunidad.

Para bloquear un contenido violento o que infrinja los derechos de autor, Facebook cuenta con un sistema combinado de algoritmos y revisores humanos, pero estos automatismos se basan en archivos que ya presentes en sus bases de datos para agilizar el proceso. En un atentado, su detección es más complicada, reconoce en un comunicado Chris Sonderby, vicepresidente y consejero general adjunto de Facebook.

Sillitas para esperar el autobús,

la última invención en una economía compartida

Sillitas para esperar el autobús,

la última invención en una economía compartida Se filtra por error el sexto episodio

de «Juego de Tronos»

Se filtra por error el sexto episodio

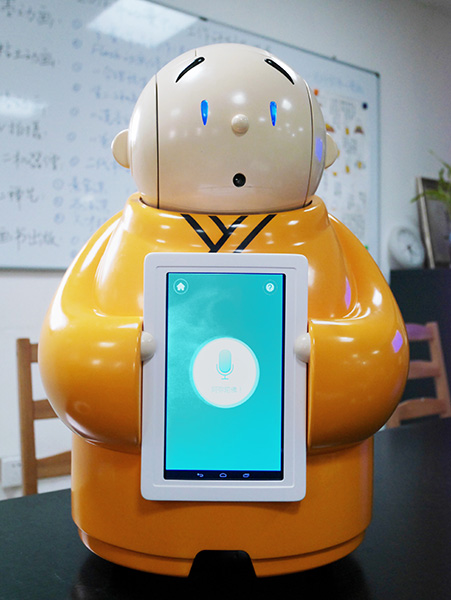

de «Juego de Tronos» Un robot monje aprende a hablar inglés

Un robot monje aprende a hablar inglés Se estrena el documental

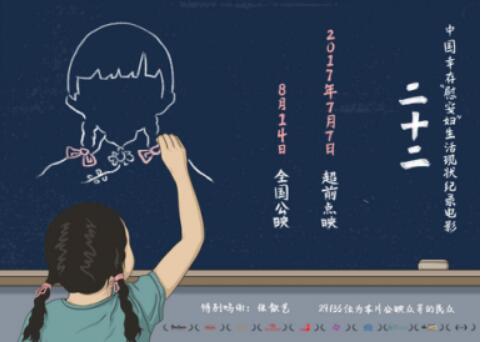

sobre “mujeres de consuelo” de China

Se estrena el documental

sobre “mujeres de consuelo” de China 57 universidades chinas

entre las 500 mejores del mundo

57 universidades chinas

entre las 500 mejores del mundo Las 10 cadenas hoteleras

más grandes del mundo

Las 10 cadenas hoteleras

más grandes del mundo ¿Cuánto paga un residente extranjero

por un alquiler en Beijing?

¿Cuánto paga un residente extranjero

por un alquiler en Beijing? Un graduado de Tsinghua convierte

la cría del esturión cuchara en una mina de oro

Un graduado de Tsinghua convierte

la cría del esturión cuchara en una mina de oro La dedicación de una niña

al arte de la Ópera de Pekín

La dedicación de una niña

al arte de la Ópera de Pekín